À l’approche du Forum InCyber qui se tiendra la semaine prochaine à Lille, un enjeu de résilience vient bousculer les agendas traditionnels : la transition cryptographique post-quantique. Si le fameux « Q-Day », ce moment théorique où un ordinateur quantique sera capable de briser les standards cryptographiques actuels, semble relever d’un horizon technique encore incertain, le G7 a pourtant tiré la sonnette d’alarme au début de l’année 2026, qualifiant ce risque de systémique pour l’écosystème financier international. Il ne s’agit donc plus d’une spéculation de laboratoire, mais d’une vulnérabilité immédiate qui redessine les contours de la confiance numérique.

L’urgence pour les entreprises ne réside pas dans l’imminence de la commercialisation d’une machine quantique parfaite, mais dans la prolifération silencieuse des attaques de type « harvest now, decrypt later » (récolter aujourd’hui, déchiffrer plus tard). Des acteurs malveillants s’amusent donc à capturer et archiver massivement des flux de données chiffrées transitant sur les réseaux (dossiers financiers, secrets industriels, données de santé, etc.) dans l’unique but de les déverrouiller lorsque la technologie quantique aura atteint sa maturité.

Et la démonstration de cette menace technologique se concrétise progressivement. À titre d’exemple, Namirial a récemment prouvé la faisabilité du concept en factorisant une clé RSA de 4 bits en environ quatre secondes sur une infrastructure quantique réelle d’AWS. Bien qu’il s’agisse d’une expérimentation à échelle très réduite, elle matérialise l’obsolescence mathématique programmée de nos systèmes actuels.

La pression s’exerce également sur le terrain géopolitique : 69 % des décideurs IT disent, en effet, redouter qu’une attaque de grande ampleur ne rende leurs données lisibles par un État hostile d’ici 10 ans. Cette inquiétude est par ailleurs alimentée par des affirmations (non vérifiables) prêtant à la Chine le test d’armes cyber quantiques et à la Russie le développement d’une navigation quantique.

De l’algorithme à la gouvernance : l’impératif de crypto-agilité

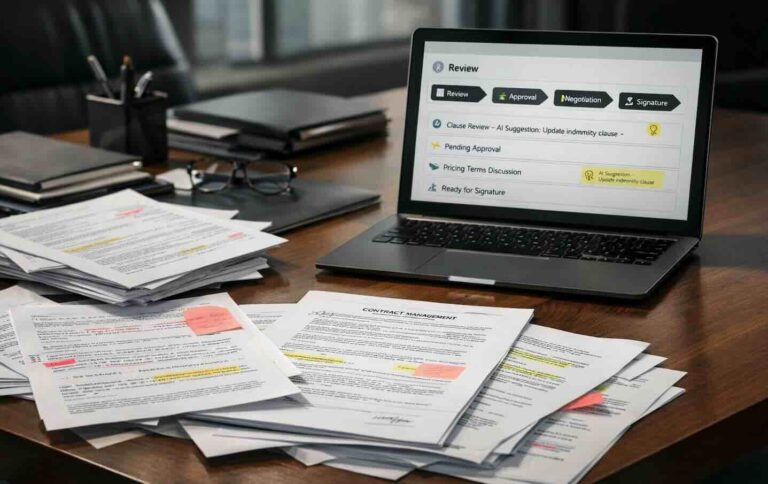

Face à cette lame de fond, la régulation s’organise et impose un changement de paradigme. En France, l’ANSSI exige désormais une approche hybride pour la certification, consistant à superposer des algorithmes résistants au quantique aux couches de chiffrement classique éprouvées. À l’international, le NIST (National Institute of Standards and Technology) a finalisé ses normes post-quantiques, comme l’algorithme Kyber, et prône dans ses recommandations récentes : la « crypto-agilité ». L’idée n’étant plus de remplacer un algorithme par un autre de façon ponctuelle, mais de concevoir des architectures capables d’évoluer en continu, sans rupture applicative.

Pourtant, le marché accuse un décalage inquiétant entre la théorie et la pratique. Seules 25 % des entreprises françaises ont entamé des plans concrets de transition, et la moitié d’entre elles pointent du doigt l’absence d’engagement et de directives claires de la part de leur conseil d’administration. La cryptographie, jusqu’ici reléguée au rang de commodité purement technique, doit impérativement être repensée comme un risque majeur de « supply chain ». La faiblesse d’une seule intégration cloud ou d’un fournisseur tiers peut compromettre l’ensemble d’un écosystème d’information.

Le grand écart entre l’innovation du marché et la dette technique

Pour accompagner les entreprises, les fournisseurs de technologies accélèrent le déploiement de solutions « quantum-ready ». Des acteurs de la gestion des accès comme Keeper Security intègrent nativement l’algorithme Kyber pour sécuriser les communications client-serveur, tandis que Cloudflare déploie le chiffrement post-quantique par défaut et sans surcoût sur l’ensemble de son infrastructure réseau SASE.

Le matériel évolue également. Dell introduit des signatures résistantes aux attaques quantiques au plus profond du BIOS de ses PC professionnels, et des industriels comme SEALSQ développent des puces TPM (Trusted Platform Module) post-quantiques pour sécuriser les équipements embarqués et l’IoT dès leur conception.

Cette effervescence technologique se heurte toutefois au mur de la réalité opérationnelle. Un récent rapport de Kyndryl révèle une friction majeure : alors que les entreprises tentent de se moderniser, 25 % de leurs réseaux, serveurs et systèmes de stockage critiques sont en fin de vie. Tenter d’orchestrer une transition cryptographique complexe sur des environnements réseau vieillissants et fragmentés génère d’importants angles morts et limite sévèrement la résilience globale.

L’heure de l’inventaire

In fine, le passage à l’ère post-quantique s’apparente moins à un saut technologique immédiat qu’à un long marathon de conformité et d’hygiène informatique. Comme le rappelleront certainement les experts de Keyfactor lors du Forum InCyber, si 2025 fut l’année de la prise de conscience, 2026 doit être impérativement celle de l’inventaire cryptographique exhaustif, avant le début des migrations prioritaires estimé pour 2028.

Le plus grand obstacle pour les RSSI et les décideurs ne sera donc pas de sélectionner l’algorithme le plus robuste, mais d’obtenir une visibilité totale sur les clés et certificats invisibles qui soutiennent aujourd’hui leurs infrastructures, avant que le bouclier mathématique de la confiance numérique ne se fissure.