La start-up française Label4.ai entre dans une phase offensive de commercialisation avec une promesse devenue centrale pour l’économie numérique : détecter, marquer et tracer les contenus générés ou manipulés par intelligence artificielle. Le sujet est sérieux, car derrière la promesse technologique, une vraie bataille s’ouvre entre détection forensique, watermarking, standards de provenance et exigences réglementaires européennes.

Créée en décembre 2024 par six cofondateurs issus notamment de l’Inria et du CNRS, Label4.ai s’attaque à un problème devenu massif : distinguer un contenu authentique d’un contenu généré ou altéré par IA. L’entreprise revendique une couverture large (image, vidéo, audio, document, texte et code) articulée autour de deux axes : la détection forensique et le marquage invisible. Pour cela, elle a levé environ un million d’euros en 2025, remporté deux distinctions au Forum InCyber 2026, et s’inscrit clairement dans un récit de souveraineté technologique.

Label4.ai se positionne sur un marché qui bascule d’un sujet de démonstration vers un sujet de conformité, de fraude et de preuve. La Commission européenne a d’ailleurs lancé un code de bonnes pratiques pour aider à appliquer les obligations de transparence prévues par l’article 50 de l’AI Act. Ce cadre vise explicitement le marquage des contenus générés par IA, leur détectabilité et l’étiquetage des deepfakes. Notez que les règles correspondantes deviendront applicables le 2 août 2026.

Pendant des mois, le marché a parlé des deepfakes comme d’un risque médiatique diffus. Le cadre européen force maintenant les acteurs à se demander comment produire un signal de confiance exploitable, vérifiable et interopérable à grande échelle ? Label4.ai tente d’y répondre en combinant deux logiques complémentaires, la détection ex post et le marquage à la source. L’approche est cohérente, mais elle ne constitue pas encore, à elle seule, un standard de marché.

Des concurrents qui ne jouent pas tous le même match

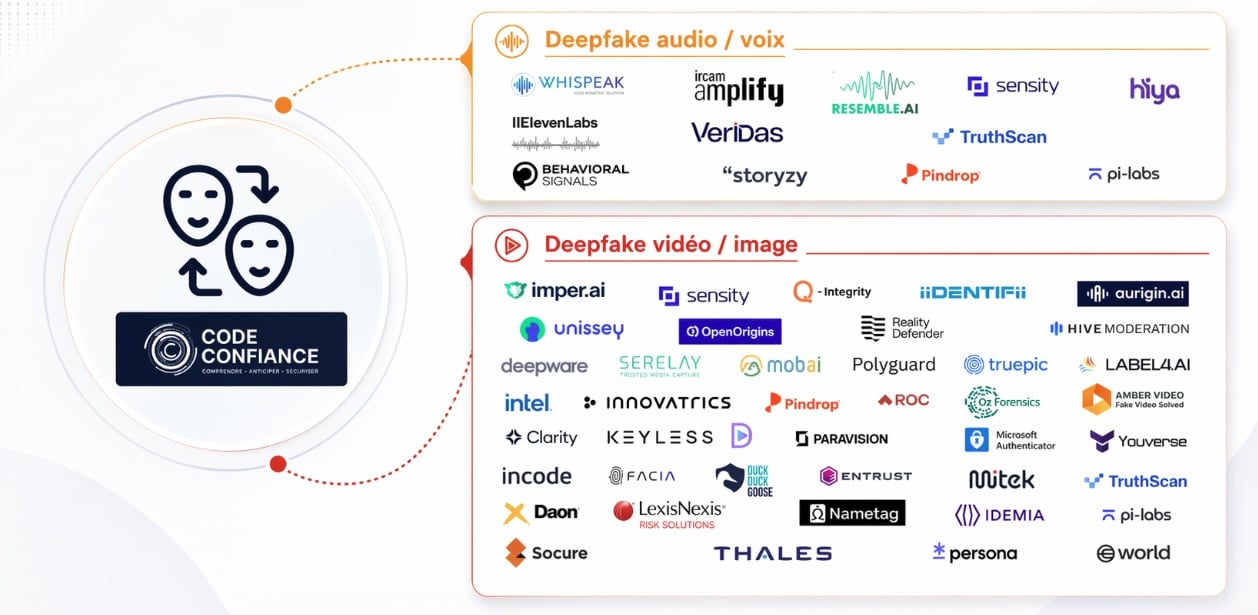

Un marché qui s’avère d’ailleurs fragmenté, avec des acteurs qui ne se ressemblent pas. Une étude britannique consacré à la détection des deepfakes rappelle que cet écosystème reste jeune, dispersé et difficile à comparer objectivement. Le rapport recensait 59 fournisseurs tiers dans le monde en 2025, dont 23 basés aux États-Unis. Il met également en exergue les principaux freins, à savoir le coût technique élevé, le manque de données représentatives, l’adoption lente et les doutes persistants sur la fiabilité réelle des solutions. Le panorama que Code Confiance a établi en début d’année 2026 illustre concrètement cette densité avec une quarantaine d’acteurs identifiés, répartis entre deux segments distincts : détection audio/voix d’un côté, détection vidéo et image de l’autre.

Sur le segment audio, les marques qui s’imposent sont Pindrop, Resemble.AI, Hiya, VeriDas ou encore Ircam Amplify, ce dernier étant un acteur français à ne pas négliger. Ces solutions ciblent principalement la fraude vocale, l’usurpation d’identité téléphonique et l’authentification dans les centres de contact. Le segment vidéo et image est nettement plus dense. Y figurent des spécialistes de la détection forensique comme Reality Defender, Sensity, Deepware ou Amber Video, mais aussi des acteurs positionnés sur la vérification d’identité en temps réel (Incode, Daon, IDEMIA, Thales, Entrust, Mitek, Socure…) qui intègrent la détection de deepfake comme une couche de leur offre d’onboarding ou d’authentification. Label4.ai est présent dans ce second segment, aux côtés de Truepic et d’OpenOrigins, deux acteurs dont l’approche est davantage orientée provenance et certification que détection pure.

Autrement dit, une famille d’acteurs détecte après coup, en analysant les artefacts laissés par la génération IA. Une autre famille marque à la source et certifie la provenance, s’appuyant sur des standards ouverts comme C2PA. Adobe pousse Content Credentials dans cette direction, avec une coalition qui revendique désormais plus de 500 entreprises (Microsoft, Google, Meta, OpenAI, Sony, BBC, Truepic). En France, Imatag défend une logique similaire fondée sur le watermarking invisible, en soulignant toutefois que les métadonnées seules ne suffisent pas, car elles peuvent être supprimées par les plateformes ou dégradées dans les flux de diffusion. Label4.ai tente de combiner les deux logiques. C’est son pari différenciateur.

Le vrai test commence maintenant

Le discours de Label4.ai est donc crédible dans son principe. Son ancrage scientifique est réel, son timing réglementaire est bon, et son positionnement français peut parler à des banques, des assureurs, des médias, des acteurs publics ou des industriels soucieux de souveraineté. Mais le marché de la confiance numérique ne récompense pas les intentions. Il récompense la robustesse, l’intégration et la preuve.

C’est précisément là que les choses se corsent. Le rapport britannique insiste sur le manque de métriques standardisées et sur la difficulté de comparer sérieusement les performances entre fournisseurs. Il faudra donc des benchmarks, des cas d’usage documentés, des taux d’erreur mesurés sur des contenus compressés, recadrés, réencodés ou partiellement modifiés.

Label4.ai montre en tout cas qu’un nouveau marché émerge au croisement de la fraude augmentée par l’IA, de la conformité européenne et de la guerre des standards de provenance.